2 червня 2023 р., 23:56

Переклад: Cyril Y.

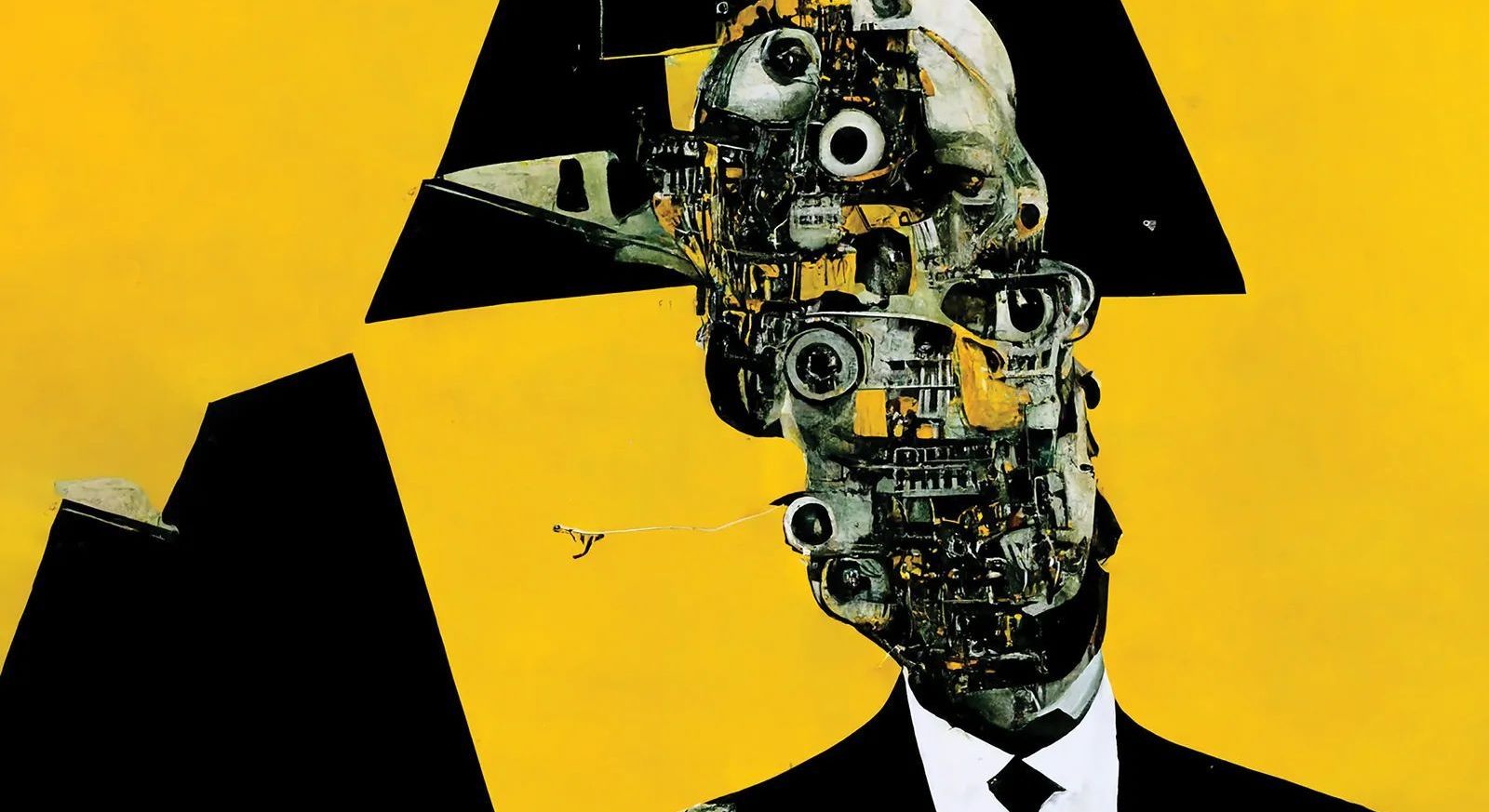

Подивитися джерелоЮвал Ной Харарі стверджує, що ШІ вже “хакнув операційну систему” нашої цивілізації

Комп’ютери, що здатні вигадувати історії, змінять хід історії людства, вважає історик і філософ

Страхи перед штучним інтелектом (ШІ) переслідують людство з самого початку комп’ютерної ери. Досі ці страхи зосереджувалися на машинах, які використовували фізичні засоби для вбивства, поневолення або заміни людей. Але за останні пару років з’явилися нові інструменти штучного інтелекту, які загрожують виживанню людської цивілізації з несподіваного боку. Штучний інтелект набув дивовижних здібностей маніпулювати мовою та генерувати історії за допомогою слів, звуків чи зображень. AI таким чином зламав операційну систему нашої цивілізації.

Мова — це те, з чого складається майже вся людська культура. Права людини, наприклад, не вписані в нашу ДНК. Скоріше це культурні артефакти, які ми створили, розповідаючи історії та пишучи закони. Боги не є фізичними реальностями. Це скоріше культурні артефакти, які ми створили, вигадуючи міфи та записуючи історії.

Гроші також є культурним артефактом. Банкноти — це лише різнокольорові папірці, і наразі понад 90% грошей — це навіть не банкноти — це просто цифрова інформація в комп’ютерах. Цінність грошей забезпечуються історіями, які нам про них розповідають банкіри, міністри фінансів і гуру криптовалют. Сем Бенкман-Фрід, Елізабет Холмс і Берні Медофф не були особливо вправними у створенні справжньої цінності, але всі вони були надзвичайно здібними оповідачами.

Що трапиться, коли нелюдський інтелект стане кращим за звичайну людину в тому, щоб розповідати історії, складати мелодії, малювати образи та писати закони та наративи? Коли люди думають про ChatGPT та інші нові інструменти штучного інтелекту, їх часто привертають випадки, наприклад, як школярі використовують штучний інтелект для написання екзамену. Що станеться зі шкільною системою, коли всі діти почнуть так робити? Але таке запитання не показує маштабів картини. Забудьте про шкільні реферати. Подумайте про наступні президентські вибори в США у 2024 році та спробуйте уявити вплив інструментів штучного інтелекту, які можна використовувати для масового виробництва політичного контенту, фейкових новин і наративів для нових культів.

В останні роки конспірологічний культ qAnon об’єднався навколо анонімних онлайн-повідомлень, відомих як «q drops (краплі)». Послідовники збирали, шанували та інтерпретували ці краплинки “q” як священний текст. Хоча, наскільки нам відомо, усі попередні q-дропи створювалися людьми, а боти лише допомагали їх поширювати, у майбутньому ми можемо побачити перші в теорії змови, які були написані штучним розумом. Релігії протягом всієї історії стверджували, що їхні священні книги мають нелюдське походження. Незабаром це може стати реальністю.

На більш прозаїчному рівні незабаром ми можемо опинитись у веденні тривалих онлайн-дискусій про аборти, зміну клімату чи російське вторгнення в Україну з істотами, які, на нашу думку, є людьми, але насправді є штучними інтелектами. Заковика полягає в тому, що для нас абсолютно безглуздо витрачати час на те, щоб змінити декларовані думки ботів штучного інтелекту, тоді як штучний інтелект може відшліфувати свої повідомлення настільки точно, що він має хороші шанси вплинути на нас.

Завдяки своєму майстерному володінню мовою штучний інтелект міг навіть налагоджувати близькі стосунки з людьми та використовувати силу близькості, щоб змінювати наші думки та світогляд. Хоча немає жодних ознак того, що штучний інтелект має власну свідомість чи почуття, для сприяння фальшивої близькості з людьми достатньо для того, щоб штучний інтелект міг змусити їх відчувати до себе емоційну прив’язаність. У червні 2022 року Блейк Лемуан, інженер Google, публічно заявив, що штучний чат-бот Lamda, над яким він працював, став розумним. Спірне твердження коштувало йому роботи. Найцікавішим у цьому епізоді було не твердження містера Лемуана, яке, ймовірно, було неправдивим. Швидше, це була його готовність ризикнути своєю прибутковою роботою заради чат-бота штучного інтелекту. Якщо штучний інтелект може вплинути на те, щоб люди ризикували своєю роботою заради нього, до чого ще він може їх спонукати?

У політичній битві за розуми та серця близькість є найефективнішою зброєю, і штучний інтелект щойно отримав здатність масово створювати інтимні стосунки з мільйонами людей. Ми всі знаємо, що за останнє десятиліття соціальні мережі стали полем битви за контроль над людською увагою. З новим поколінням штучного інтелекту фронт битви зміщується від уваги до приватності. Що станеться з людським суспільством і людською психологією, коли штучний інтелект буде боротися з іншим штучним інтелектом у боротьбі за підробку близьких та довірительних стосунків з нами, які потім можуть бути використані, щоб переконати нас голосувати за певних політиків або купувати певні продукти?

Навіть без створення «фальшивої близькості» нові інструменти ШІ мали б величезний вплив на наші думки та світогляд. Люди можуть почати використовувати одного порадника з штучного інтелекту як єдиного всезнаючого оракула. Не дивно, що Google наляканий. Навіщо шукати, коли я можу просто запитати оракула? Індустрії новин і реклами також повинні бути налякані. Навіщо читати газету, якщо я можу просто попросити оракула розповісти мені останні новини? І яка мета реклами, коли я можу просто попросити оракула сказати мені, що саме мені купити?

І навіть ці сценарії насправді не відображають масштабів загальної картини. Те, про що ми говоримо, є потенційним кінцем історії людства. Не кінець історії, а лише кінець її частини, де домінує людина. Історія — це взаємодія біології та культури; між нашими біологічними потребами та бажаннями в таких речах, як їжа та секс, і нашими культурними творіннями, такими як релігії та закони. Історія — це процес, за допомогою якого закони та релігії формують їжу та секс.

Що станеться з ходом історії, коли штучний інтелект захопить культуру та почне створювати історії, мелодії, закони та релігії? Попередні інструменти, такі як друкарський верстат і радіо, допомагали поширювати культурні ідеї людей, але вони ніколи не створювали нових культурних ідей. ШІ має принципову відмінність. ШІ може створювати абсолютно нові ідеї, абсолютно нову культуру.

Спочатку штучний інтелект, ймовірно, імітуватиме людські прототипи, на яких його навчали в зародковому стані. Але з кожним роком штучна інтелектуальна культура сміливо йтиме туди, куди раніше не заходила жодна людина. Тисячоліттями люди жили в мріях інших людей. У найближчі десятиліття ми можемо опинитись у снах інопланетного розуму.

Страх перед штучним інтелектом переслідує людство лише кілька останніх десятиліть. Але протягом тисячоліть людей переслідував набагато глибший страх. Ми завжди цінували силу історій і образів, які маніпулювали нашим розумом і створювати ілюзії. Отже, з давніх часів люди боялися потрапити в пастку світу ілюзій.

У 17 столітті Рене Декарт побоювався, що, можливо, якийсь злий демон заманює його в пастку світу ілюзій, створюючи все, що він бачить і чує. У Стародавній Греції Платон розповів знамениту алегорію печери, в якій група людей все життя була прикута всередині печери, обличчям до глухої стіни. Екран. На цьому екрані вони бачать проекції різниї тіней. Ув'язнені помилково приймають побачені там ілюзії за реальність.

У стародавній Індії буддійські та індуїстські мудреці вказували на те, що всі люди живуть у пастці майя — світу ілюзій. Те, що ми зазвичай сприймаємо як реальність, у нашій свідомості часто є лише вигадкою. Люди можуть вести цілі війни, вбиваючи інших і самі бажаючи бути вбитими через свою віру в ту чи іншу ілюзію.

Революція ШІ ставить нас обличчям до декартівського демона, до печери Платона, до майя. Якщо ми не будемо обережні, ми можемо опинитися в пастці за завісою ілюзій, яку ми навіть не зможемо розгледіти — або навіть усвідомити, що вона існує.

Звичайно, нову потужність штучного інтелекту також можна використовувати в благих цілях. Я не буду на цьому зупинятися, тому що люди, які розробляють ШІ, говорять про це і так достатньо. Робота таких істориків і філософів, як я, полягає в тому, щоб вказувати на небезпеку. Але, безсумнівно, штучний інтелект може допомогти нам багатьма способами: від пошуку нових ліків від раку до вирішення екологічної кризи. Питання, перед яким ми постаємо, полягає в тому, як переконатися, що нові інструменти штучного інтелекту використовуються на благо, а не на зло. Для цього нам спочатку потрібно оцінити справжні можливості цих інструментів.

З 1945 року ми знаємо, що ядерна технологія може генерувати дешеву енергію на благо людей, але також може фізично знищити людську цивілізацію. Тому ми змінили весь міжнародний порядок, щоб захистити людство та переконатися, що ядерні технології використовуються переважно на благо. Тепер нам доводиться боротися з новою зброєю масового знищення, яка може знищити наш ментальний і соціальний світ.

Ми все ще можемо регулювати нові інструменти ШІ, але ми повинні діяти швидко. У той час як ядерне озброєння не може винайти більш потужне ядерне озброєння, ШІ може зробити експоненціально потужнішу версію ШІ. Перший важливий крок — вимагати суворої перевірки безпеки перед тим, як потужні інструменти штучного інтелекту стануть загальнодоступними. Подібно до того, як фармацевтична компанія не може випускати нові ліки, перш ніж перевірити їх короткострокові та довгострокові побічні ефекти, так і технологічні компанії не повинні випускати нові інструменти штучного інтелекту, поки вони не стануть безпечними. Нам потрібен еквівалент Управління з контролю за якістю харчових продуктів і медикаментів для нових технологій, і він нам потрібен ще на вчора.

Чи не призведе уповільнення публічного розгортання штучного інтелекту до відставання демократій від більш безжальних авторитарних режимів? Якраз навпаки. Нерегульоване розгортання штучного інтелекту створить соціальний хаос, який піде на користь автократам і зруйнує демократії. Демократія – це розмова, а розмова залежить від мови. Коли штучний інтелект “зламує” мову, він може знищити нашу здатність вести змістовні розмови, тим самим зруйнувавши і демократію.

Щойно ми зіткнулися з інопланетним розумом тут, на Землі. Ми мало що знаємо про це, крім того, що це може знищити нашу цивілізацію. Ми повинні припинити безвідповідальне розгортання інструментів штучного інтелекту в публічній сфері та регулювати штучний інтелект до того, як він зарегулює нас. І перше правило, яке я б запропонував, це зробити обов’язковим для ШІ розкриття того, що це ШІ. Якщо я розмовляю з кимось і не можу сказати, людина це чи штучний інтелект — це кінець демократії.

Цей текст створено людиною.

Але це не точно.